Le numérique responsable à travers le prisme de l'IA

🕓 Temps de lecture 2 minutes

Comme chaque année, le service e-Learning saisit l’occasion de la semaine du Digital CleanUp Day (du 16 au 21 mars 2026) pour inviter les équipes de HELMo à réfléchir à leurs usages numériques, et à adopter des pratiques plus responsables.

En 2026, au-delà du traditionnel nettoyage des données et de la sensibilisation à la cybersécurité, nous souhaitons élargir la réflexion, cette année, en abordant le numérique responsable à travers le prisme de l’intelligence artificielle.

🗓️ Pour explorer cette thématique de manière concrète et conviviale, nous vous donnons RENDEZ-VOUS JEUDI 19 MARS à 12h30 pour une session en ligne de 30 minutes.

Inscrivez-vous via ce lien 👉 Croc & Learn : Green and Ethical AI

Pourquoi en parler ?

Dans sa globalité, nous savons déjà que le numérique a un impact environnemental (principalement à cause de la fabrication des équipements) et qu'il représente 3 à 4 % des émissions mondiales de gaz à effet de serre (GES).

Si l'intelligence artificielle (IA) représente actuellement une part minoritaire de cet impact numérique, elle est cependant en très forte croissance et mérite donc qu'on s'y intéresse de plus près 🧐

Quels sont les impacts de l'IA sur l’environnement ?

Souvent perçu comme virtuel, le numérique repose bel et bien sur une base matérielle qui affecte l’environnement à plusieurs niveaux, tout au long de son cycle de vie.

L'infrastructure nécessaire aux usages de l'IA (serveurs, puces, équipements réseau, etc.) n'échappe pas à ce constat, puisque ces équipements sont fabriqués à partir de matières premières rares dont l’extraction polluante fait pression sur les ressources naturelles. En fin de vie, ils génèrent une quantité croissante de déchets électroniques, dont une partie contient des substances toxiques, comme le mercure ou le plomb, qui ne sont pas toujours correctement recyclables.

L’entraînement des grands modèles d'IA et leur utilisation au quotidien mobilisent des centres de données puissants, qui tournent en continu pour traiter des milliards de requêtes. L'électricité utilisée pour ces tâches, provenant majoritairement d'énergie fossiles, augmente directement les émissions de GES.

À cette empreinte énergétique s’ajoute le besoin de quantités importantes d’eau pour refroidir les serveurs et maintenir les infrastructures à une température stable. Prélevée dans des ressources locales parfois déjà sous tension, cette eau peut entrer en concurrence avec d’autres usages, comme l’eau potable ou l’agriculture.

Que faire pour limiter son impact environnemental lié à l’IA ?

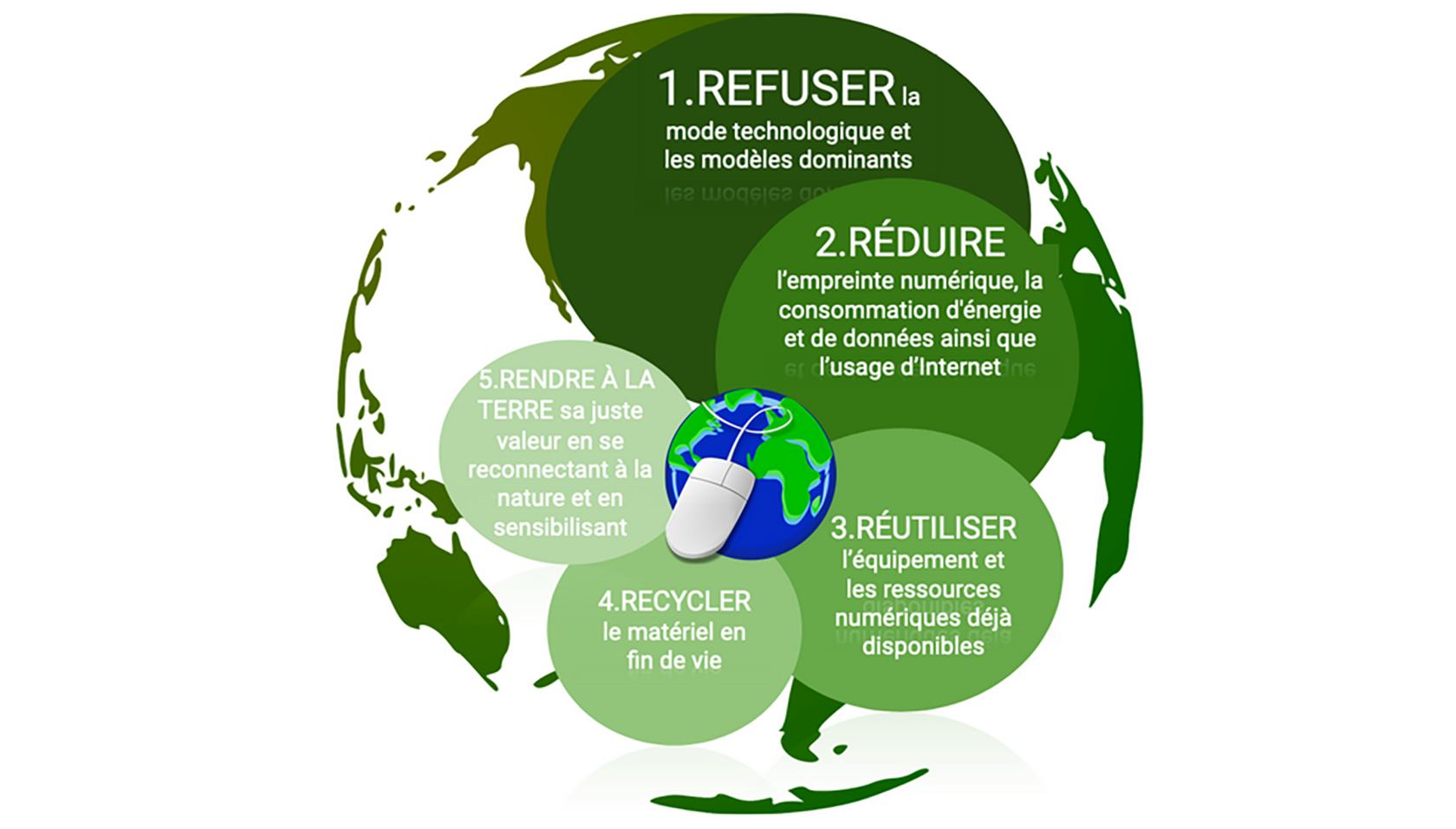

En suivant la démarche des 5R (Refuser, Réduire, Réutiliser, Recycler et Rendre à la Terre), généralement mise en avant dans les pratiques Zéro déchets, nous pouvons transformer notre rapport à l’IA et ainsi alléger concrètement notre empreinte environnementale 😀

Résumé de la démarche des 5R numériques [https://profsentransition.com]

REFUSER

- Avant d’ouvrir un chatbot ou un générateur d’images, se demander si la tâche (rédiger un mail simple, vérifier une règle de grammaire, réaliser une recherche web, etc.) nécessite l'usage de l'IA;

- Désactiver les « assistants IA » intégrés automatiquement dans les outils (suite bureautique, moteur de recherche, réseau social);

- Ne pas recourir à l’IA pour générer des images, vidéos ou présentations spectaculaires si une solution plus simple suffit (modèle de diapo, banque d’images existantes, schéma fait maison).

RÉDUIRE

- Regrouper ses questions, préparer son prompt, pour viser moins d'échanges de messages;

- Quand c’est possible, privilégier une IA spécialisée (traduction, correction, résumé) plutôt qu’un gros modèle génératif, beaucoup plus gourmand en ressources [https://www.uneiaparjour.fr/se...];

- Limiter la production d’images ou de vidéos via IA, très coûteuse en calcul, et privilégier le texte, les visuels existants ou la réutilisation de contenus déjà créés.

Nous pouvons également, publier nos prompts afin qu’ils servent à d’autres sans recalcul massif, choisir des outils hébergés sur des data centers verts pour soutenir des pratiques plus durables, supprimer les fichiers IA accumulés pour réduire la pression sur les serveurs, etc.

L'IA, a-t-elle également un impact éthique ?

Les systèmes d’intelligence artificielle sont formés à partir de données issues du monde réel, elles-mêmes marquées par des inégalités sociales, économiques et culturelles. Il n’est donc pas surprenant que ces modèles reproduisent, voire amplifient, ces déséquilibres. Cela peut se traduire par des traitements différenciés selon le genre, l’origine, l’âge ou le contexte socio-économique, tout en donnant parfois l’illusion d’une objectivité « neutre » et « mathématique ».

Beaucoup de modèles d’IA fonctionnent comme des boîtes noires qui produisent des résultats sans que l’on comprenne clairement comment ils ont été établis. Cette opacité rend difficile la vérification de leur pertinence ou la contestation d’une décision.

Ces technologies reposent souvent sur la collecte et l’analyse de grandes quantités de données personnelles (comportements, déplacements, interactions, préférences, etc.) fragilisant la frontière entre vie publique et vie privée. Se posent alors des questions essentielles sur le consentement, la maîtrise de nos données et les usages qui peuvent en découler.

En facilitant et automatisant de nombreuses tâches, l’IA peut également modifier notre rapport à la décision. À force de déléguer nos choix ou nos analyses, nous risquons de perdre certaines compétences clés telles que l'esprit critique et l'autonomie.

L’IA transforme aussi nos interactions. Les agents conversationnels, par exemple, gèrent efficacement les demandes simples, mais laissent parfois les situations plus délicates sans réponse humaine adaptée, au risque d’affaiblir la qualité relationnelle.

Enfin, les algorithmes de recommandation présents sur les plateformes sociales privilégient souvent les contenus susceptibles de retenir l’attention, quitte à renforcer les propos clivants ou extrêmes.

Pour ou contre ?

Situation 1 : Un prof évalue des travaux d'étudiants avec l'IA

Quand l’IA corrige des copies ou note des devoirs, elle risque de réduire l’humain à un score algorithmique. Sans transparence sur ses critères, les élèves perdent la possibilité de contester ou de comprendre leurs erreurs, et les enseignants se retrouvent dépossédés de leur rôle de guide. Pire, des biais cachés dans les modèles peuvent pénaliser certains profils (langage familier, origines culturelles différentes) sans que personne ne s’en rende compte.

Situation 2 : Un étudiant travaille son TFE avec l'IA

Injecter dans l’IA des informations sur les stages en entreprise expose des données personnelles à des risques majeurs. Qui garantit que ces données ne seront pas stockées indéfiniment, réutilisées pour d’autres finalités ou partagées avec des tiers ?

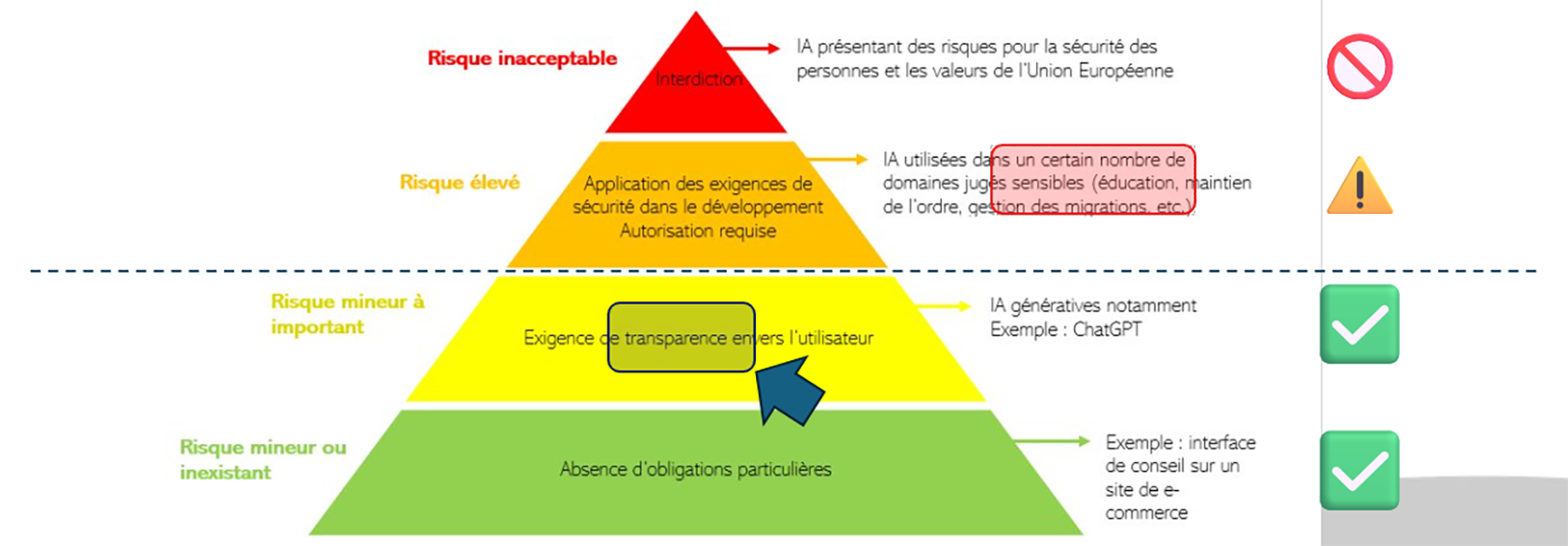

La pyramide des risques selon l'IA Act

En conclusion

L’intelligence artificielle a des effets importants tant environnemental qu'éthique. Elle modifie profondément nos façons de décider, d’exploiter les données, de collaborer, de vivre son monde. Il est essentiel de continuer à nous interroger sur ces impacts et d’explorer collectivement des usages plus responsables.

Au sein de HELMo, nous pouvons partager nos expériences, tester des approches plus sobres et privilégier des outils ouverts et réfléchis.

En cultivant une approche critique et mesurée de ces technologies, nous renforçons notre capacité à proposer un apprentissage cohérent avec nos valeurs éthiques et environnementales.

Pour aller plus loin

- La loi européenne sur l'intelligence artificielle

- Le site du Digital Cleanup Day

- Comment adopter la sobriété numérique ? (PDF de l'ADEME)

- Les 5R de la sobriété numérique

- Institut belge du numérique responsable

👉 L’espace "Numérique responsable" sur la plateforme pédagogique de HELMo

Nos articles précédents :

- Grand nettoyage numérique de printemps ! (mars 2025)

- Notre article "Le défi du Numérique Responsable : bilan 2024" (mai 2024)

- Notre article "Le défi du numérique responsable" (mars 2024)

- Notre article "Le numérique responsable" (février 2024)